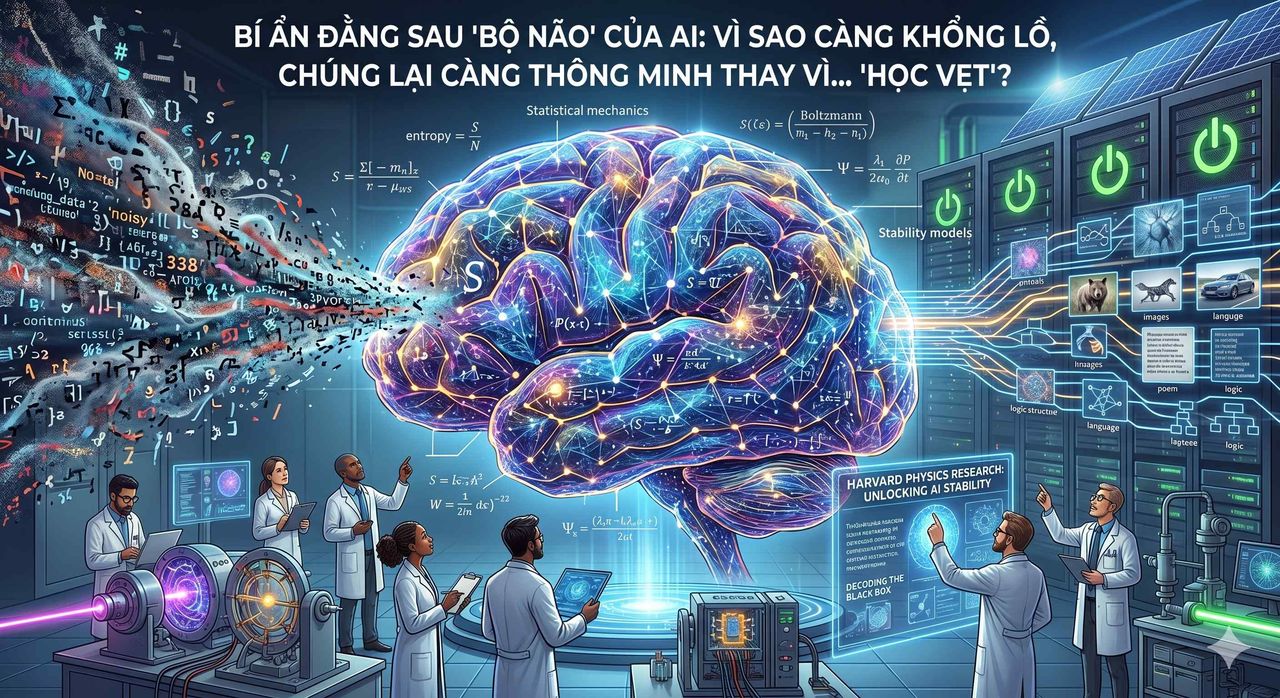

Bí ẩn đằng sau "bộ não" của AI: Vì sao càng khổng lồ, chúng lại càng thông minh thay vì... "học vẹt"?

AI giống như một “hộp đen” đầy bí ẩn mà ngay cả những người tạo ra nó cũng chưa hiểu hết nguyên lý vận hành bên trong. Tuy nhiên, một...

AI giống như một “hộp đen” đầy bí ẩn mà ngay cả những người tạo ra nó cũng chưa hiểu hết nguyên lý vận hành bên trong. Tuy nhiên, một nhóm nhà vật lý tại Harvard vừa công bố một nghiên cứu mang tính bước ngoặt, sử dụng những lý thuyết vật lý cổ điển để giải mã tại sao các siêu máy tính như ChatGPT hay Gemini lại có khả năng học hỏi vượt trội. Thay vì bị rối loạn bởi lượng dữ liệu khổng lồ, AI lại biết cách biến những “tiếng nhiễu” thành công cụ để ổn định tư duy. Khám phá này không chỉ giúp chúng ta hiểu về AI hơn mà còn mở ra con đường tạo ra những hệ thống trí tuệ nhân tạo ít tốn kém điện năng và hiệu quả hơn trong tương lai.

Khi chúng ta đang sống trong “thời kỳ mù mờ” của trí tuệ nhân tạo

Dạo gần đây, đi đâu chúng ta cũng nghe nhắc đến AI. Từ việc nhờ nó viết một bài thơ tình, giải hộ bài toán hóc búa, cho đến việc nó có thể tự tạo ra những video chân thực đến mức đáng sợ. Thế nhưng, có một sự thật khá hài hước mà ít người biết: chính các kỹ sư hàng đầu tại OpenAI hay Google đôi khi cũng phải gãi đầu thừa nhận rằng họ không hoàn toàn hiểu tại sao đứa con tinh thần của mình lại thông minh đến thế.

Chúng ta đang đối đãi với AI giống như cách những người tiền sử nhìn vào ngọn lửa. Họ biết dùng lửa để sưởi ấm, để nướng thịt, biết rằng cho thêm củi thì lửa sẽ cháy to hơn, nhưng họ chẳng hề biết về phản ứng hóa học hay bản chất của oxy. Trong giới khoa học, người ta gọi AI hiện nay là một “hộp đen” (black box) – tức là bạn cho dữ liệu vào đầu này, kết quả hiện ra ở đầu kia, còn cái gì đang thực sự xảy ra trong “bụng” của nó thì vẫn là một ẩn số lớn.

Các nhà khoa học tại Đại học Harvard nhận thấy rằng chúng ta đang bước vào một giai đoạn mà họ gọi là “Kỷ nguyên Kepler” của AI. Nếu bạn còn nhớ bài học lịch sử thiên văn, Johannes Kepler là người đã quan sát các hành tinh và rút ra các quy luật về quỹ đạo của chúng. Ông biết chúng quay thế nào, nhưng ông không giải thích được tại sao chúng lại quay như vậy. Phải đợi đến khi Newton xuất hiện với định luật vạn vật hấp dẫn, nhân loại mới thực sự hiểu về bản chất của vũ trụ. Với AI cũng vậy, chúng ta đã có những “định luật tỷ lệ” (scaling laws) – kiểu như “cứ cho AI ăn nhiều dữ liệu hơn, cho máy tính mạnh hơn thì nó sẽ khôn hơn” – nhưng chúng ta vẫn đang thiếu một “định luật vạn vật hấp dẫn” để giải thích cội nguồn sức mạnh đó.

Nỗi lo về “cậu học trò học vẹt” và nghịch lý của sự khổng lồ

Trong giáo dục, chúng ta sợ nhất là những học sinh “học vẹt”. Đó là những đứa trẻ có trí nhớ siêu phàm, thuộc lòng từng dấu phẩy trong sách giáo khoa nhưng khi gặp một bài toán hơi biến tấu một chút là... tịt ngòi. Trong ngành khoa học máy tính, hiện tượng này được gọi là Overfitting (Quá tải dữ liệu hay Học tủ).

Hãy tưởng tượng bạn dạy một con robot nhận biết con mèo bằng cách cho nó xem 1.000 tấm ảnh mèo nhà mình. Nếu con robot đó “quá thông minh” theo kiểu học vẹt, nó sẽ ghi nhớ luôn cả cái vết sẹo trên tai con mèo nhà bạn, cái thảm màu xanh dưới chân nó hay cái bình hoa nằm cạnh. Kết quả là, khi bạn đưa cho nó xem ảnh một con mèo trắng xinh xắn khác, nó sẽ bảo: “Đây không phải mèo, vì nó không có vết sẹo trên tai và không đứng cạnh bình hoa”. Nó đã quá tập trung vào những chi tiết rác (nhiễu) mà quên mất đặc điểm cốt lõi của loài mèo.

Theo logic thông thường, một mô hình AI càng lớn, bộ nhớ càng khủng thì nó càng dễ rơi vào cái bẫy “học vẹt” này. Với hàng tỷ thông số, lẽ ra ChatGPT chỉ nên ghi nhớ toàn bộ Internet như một cái ổ cứng khổng lồ và trả bài một cách máy móc. Nhưng sự thật lại hoàn toàn ngược lại. Càng to lớn, các mô hình AI này lại càng có khả năng “khái quát hóa” (generalize) tốt hơn. Chúng bắt đầu hiểu được các khái niệm, biết suy luận và áp dụng kiến thức vào những tình huống hoàn toàn mới mà chúng chưa từng thấy trong quá trình đào tạo. Đây chính là bí ẩn lớn nhất mà nhóm nghiên cứu tại Harvard quyết tâm giải mã.

Dùng “mô hình đồ chơi” để soi sáng siêu máy tính

Để hiểu một cỗ máy phức tạp đến mức không tưởng, các nhà vật lý có một chiêu rất hay: họ tạo ra một “mô hình đồ chơi” (toy model). Đừng để cái tên này đánh lừa, nó không phải là đồ chơi trẻ em đâu. Nó là một phiên bản toán học được tinh giản tối đa, lược bỏ hết những thứ rườm rà để giữ lại cái khung xương cốt lõi nhất.

Hãy tưởng tượng bạn muốn nghiên cứu quy luật dòng chảy của một con sông lớn như sông Cửu Long. Thay vì nhảy xuống giữa dòng nước cuồn cuộn với hàng ngàn biến số về bùn đất, tàu thuyền và thủy triều, bạn xây một mô hình thu nhỏ bằng nhựa trong phòng thí nghiệm. Ở đó, bạn kiểm soát được lượng nước, độ dốc và quan sát dòng chảy một cách rõ ràng nhất.

Nhóm nghiên cứu đã sử dụng một kỹ thuật gọi là “hồi quy Ridge” – một dạng toán học cơ bản hơn nhiều so với mạng thần kinh nhân tạo của AI – nhưng lại có những đặc điểm tương đồng kỳ lạ. Bằng cách áp dụng các công cụ của vật lý thống kê vào mô hình này, họ bắt đầu thấy những tia sáng cuối đường hầm. Họ phát hiện ra rằng, trong môi trường “đa chiều” (nơi có hàng triệu biến số cùng lúc), những quy luật vật lý bắt đầu vận hành theo cách khác hẳn so với thế giới 2 chiều hay 3 chiều mà chúng ta vẫn thấy.

Phép màu từ những “tiếng nhiễu” và lý thuyết tái chuẩn hóa

Đây là phần thú vị nhất và cũng là lúc chúng ta cần dùng đến một chút trí tưởng tượng. Trong thế giới của dữ liệu, luôn có những “tiếng nhiễu” – đó là những thông tin ngẫu nhiên, vụn vặt và không có giá trị thực tế. Bình thường, tiếng nhiễu là kẻ thù, nó làm hình ảnh bị mờ, làm âm thanh bị rè và làm AI bị mất tập trung.

Nhưng trong không gian hàng triệu chiều của các siêu AI, nhóm Harvard phát hiện ra một hiện tượng kỳ lạ: chính những biến động ngẫu nhiên này lại đóng vai trò như một “chất ổn định”. Để giải thích điều này, các nhà khoa học đã mượn một khái niệm cực kỳ nổi tiếng trong vật lý là Lý thuyết tái chuẩn hóa (Renormalization Theory).

Nghe thì có vẻ cao siêu, nhưng hãy thử tưởng tượng thế này: Bạn đang đứng trong một khu rừng. Nếu bạn đứng quá gần, bạn sẽ bị rối mắt bởi hàng vạn chiếc lá, từng vết nứt trên vỏ cây, từng con sâu đang bò (đây chính là dữ liệu chi tiết và nhiễu). Bạn sẽ chẳng biết mình đang ở đâu. Nhưng khi bạn bay lên cao bằng khinh khí cầu, những chi tiết nhỏ nhặt đó mờ dần đi, hòa quyện vào nhau. Ở một độ cao nhất định, bạn không còn thấy lá hay sâu nữa, mà bạn thấy hình dáng của cả một khu rừng, thấy con đường mòn xuyên qua và thấy cả ngọn núi phía xa.

Lý thuyết tái chuẩn hóa chính là cái “khinh khí cầu” đó. Trong các mô hình AI khổng lồ, khi dữ liệu được đẩy lên không gian siêu đa chiều, những chi tiết rác (nhiễu) sẽ tự động được hấp thụ và tích hợp vào một vài thông số quan trọng. Quá trình này giúp hệ thống tự lọc bỏ những thứ tầm thường để tập trung vào những cấu trúc lớn hơn, bền vững hơn. Nói cách khác, AI càng lớn thì nó càng có cái nhìn “toàn cảnh” tốt hơn, giúp nó không bị lạc lối trong đám lá cây của sự “học vẹt”.

AI không phải là một cỗ máy, nó là một “sinh vật” phòng thí nghiệm

Một trong những góc nhìn độc đáo nhất mà Alexander Atanasov – tác giả chính của nghiên cứu – đưa ra là chúng ta nên ngừng coi AI là những thuật toán được lập trình sẵn. Thực tế, chúng giống như những “sinh vật được nuôi cấy trong phòng thí nghiệm” hơn.

Khi các kỹ sư xây dựng một AI, họ không ngồi gõ từng dòng lệnh kiểu như: “Nếu người dùng hỏi về thời tiết, hãy tìm dữ liệu nhiệt độ”. Thay vào đó, họ tạo ra một cấu trúc mạng thần kinh (giống như bộ não con người với các sợi dây liên kết), rồi “cho nó ăn” dữ liệu và để nó tự lớn. Trí thông minh của AI không đến từ ý muốn của con người, mà nó “tự nảy sinh” (emergent behavior) từ sự kết nối phức tạp của hàng tỷ nơ-ron nhân tạo.

Việc chúng ta hiểu được các phép toán cơ bản của từng nơ-ron cũng giống như việc chúng ta biết một viên gạch được làm từ đất sét. Nhưng biết về viên gạch không có nghĩa là chúng ta hiểu tại sao khi xếp chúng lại, chúng ta có thể tạo nên một tòa lâu đài nguy nga hay một cây cầu bền vững qua trăm năm. Nghiên cứu của Harvard chính là nỗ lực đầu tiên để viết ra “kiến trúc học” cho những tòa lâu đài dữ liệu đó.

Tại sao chúng ta cần quan tâm đến điều này?

Có lẽ bạn sẽ tự hỏi: “Thì AI thông minh là tốt rồi, cần gì phải biết lý do tại sao cho mệt đầu?”. Thực ra, việc tìm ra “định luật vạn vật hấp dẫn” cho AI có ý nghĩa cực kỳ quan trọng đối với cuộc sống của chúng ta:

Tiết kiệm năng lượng: Hiện nay, việc huấn luyện một mô hình AI tiêu tốn một lượng điện năng khổng lồ, tương đương với năng lượng của cả một thị trấn nhỏ. Nếu hiểu được nguyên lý giúp AI học hiệu quả, chúng ta có thể thiết kế những hệ thống thông minh hơn mà không cần phải “vỗ béo” chúng bằng quá nhiều dữ liệu hay phần cứng đắt đỏ.

Độ tin cậy: Khi AI trở thành một phần của y tế (chẩn đoán bệnh) hay giao thông (xe tự lái), chúng ta không thể chấp nhận việc “nó hoạt động nhưng không biết tại sao”. Hiểu được cơ chế bên trong giúp chúng ta dự đoán được khi nào AI có thể sai sót và ngăn chặn những rủi ro tiềm ẩn.

Mở ra những giới hạn mới: Khi đã nắm được quy luật, con người không còn phải mò mẫm trong bóng tối nữa. Chúng ta có thể chủ động tạo ra những loại trí tuệ nhân tạo chuyên biệt, có khả năng tư duy logic sâu sắc hơn cả con người trong những lĩnh vực phức tạp như nghiên cứu thuốc chữa ung thư hay giải quyết biến đổi khí hậu.

Lời kết cho một tương lai rõ ràng hơn

Chúng ta đang đứng ở một thời khắc lịch sử của khoa học. Những gì nhóm nghiên cứu tại Harvard vừa thực hiện mới chỉ là những bước đi đầu tiên, nhưng nó đã thay đổi hoàn toàn cách chúng ta nhìn nhận về trí tuệ nhân tạo. AI không còn là một phép màu hên xui, cũng không phải là một thế lực huyền bí nằm ngoài tầm hiểu biết. Nó tuân theo những quy luật vật lý và toán học chặt chẽ, ngay cả khi những quy luật đó nằm ở một không gian hàng triệu chiều mà bộ não con người khó lòng hình dung nổi.

Từ “Kỷ nguyên Kepler” đầy rẫy những quan sát thực nghiệm, chúng ta đang tiến gần hơn đến “Kỷ nguyên Newton” của trí tuệ nhân tạo – nơi mọi sự thông minh đều có thể giải thích bằng những định luật rõ ràng. Và khi ánh sáng của tri thức soi rọi vào cái “hộp đen” kia, chúng ta không chỉ thấy những con số khô khan, mà thấy cả một tương lai nơi con người và máy móc có thể cộng tác một cách thấu hiểu và hiệu quả hơn bao giờ hết.

Hy vọng rằng trong một ngày không xa, khi bạn trò chuyện với một trợ lý AI, bạn sẽ không còn cảm thấy như đang nói chuyện với một bóng ma trong máy tính, mà là một thực thể trí tuệ được xây dựng dựa trên những nền tảng khoa học vững chắc nhất của vũ trụ. Cuộc hành trình đi tìm “trọng lực” cho AI mới chỉ bắt đầu, và những gì chờ đợi phía trước chắc chắn sẽ còn thú vị hơn cả những gì chúng ta có thể tưởng tượng ngày hôm nay.

DONATE:

Khoa học - Công nghệ

/khoa-hoc-cong-nghe

Bài viết nổi bật khác

- Hot nhất

- Mới nhất