Cuộc chiến A.I của các siêu cường: Anthropic đối đầu Trung Quốc

Đằng sau màn đấu tố giữa các công ty lớn nhất ngành AI có phải là hành động gây chiến trong cuộc cạnh tranh công nghệ Mỹ – Trung đang diễn ra gay gắt?

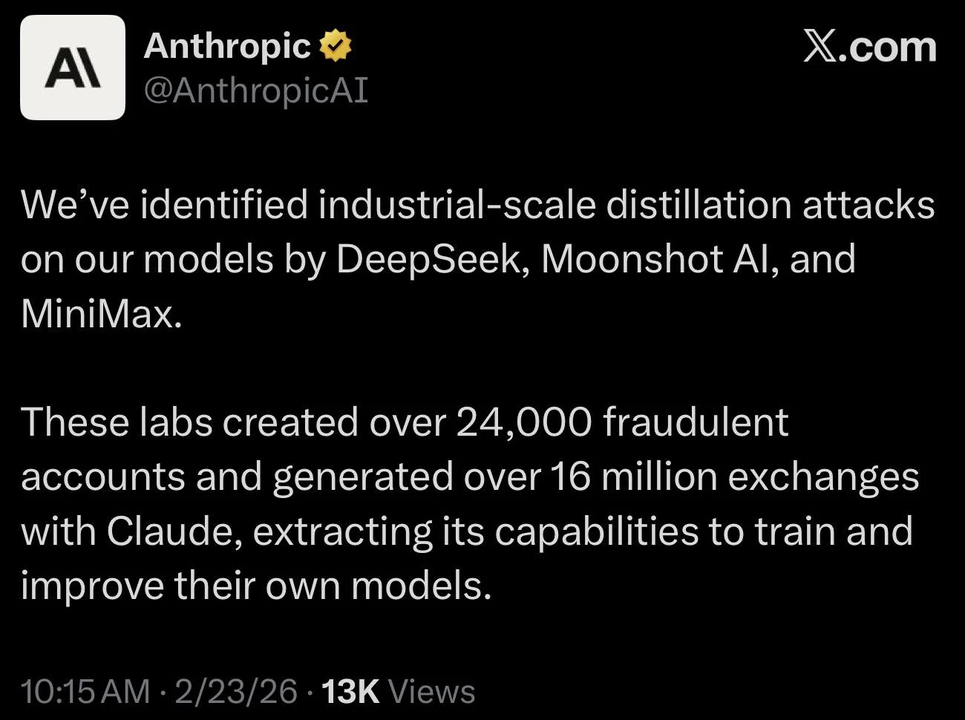

Ngày 23 tháng 2 vừa qua, công ty Anthropic bất ngờ công bố một bài blog gây chấn động giới công nghệ toàn cầu. Theo cáo buộc từ công ty đứng sau Claude, ba startup AI hàng đầu Trung Quốc là DeepSeek, Moonshot AI và MiniMax đã bí mật tạo ra khoảng 24.000 tài khoản giả, thực hiện hơn 16 triệu cuộc hội thoại để thu thập đầu ra từ Claude, rồi dùng chính khối tri thức đó để huấn luyện mô hình của mình.

Nếu chỉ tiếp cận thông thường theo các tin tức báo chí, đây có vẻ lại là một vụ bê bối quen thuộc với việc một bên tố bên kia “ăn cắp chất xám”, công chúng nổi giận với phía gây ra vấn đề, còn các luật sư thì lao vào cuộc chiến truyền thông và pháp lý. Tuy nhiên, vụ việc này còn phức tạp hơn rất nhiều. Tất cả bắt đầu với cụm từ mà giới kỹ thuật gọi bằng một cái tên rất cụ thể: chưng cất mô hình.

I. Cuộc tấn công âm thầm

Ngày 23 tháng 2 năm 2026, Anthropic, công ty chủ quản của chatbot Claude, công bố một bài blog dài với cáo buộc gây rung động làng công nghệ là 3 công ty AI hàng đầu Trung Quốc là DeepSeek, Moonshot AI và MiniMax "ăn cắp tri thức" bằng cách họ đã bí mật tạo khoảng 24.000 tài khoản giả, tạo ra hơn 16 triệu cuộc hội thoại với Claude, thu thập toàn bộ câu trả lời rồi dùng để huấn luyện mô hình AI của chính họ.

Trên phương diện kỹ thuật thì hoạt động này có tên gọi chính thức: chưng cất mô hình (model distillation).

1. "Chưng cất" nghĩa là gì?

Từ "chưng cất" trong hóa học có nghĩa là tách lấy phần tinh túy nhất từ một hỗn hợp. Chưng cất rượu là đun hỗn hợp lên men, thu lấy hơi cồn, ngưng tụ thành rượu nguyên chất. Bạn bỏ đi phần bã, phần nước, phần tạp chất, chỉ giữ lại cái tinh khiết nhất.

Chưng cất mô hình AI hoạt động theo logic tương tự, chỉ khác là thứ được "chưng cất" không phải cồn mà là tri thức.

Để xây dựng Claude, Anthropic đã chi hàng tỷ đô la, huy động đội ngũ hàng trăm nhà nghiên cứu hàng đầu thế giới, và cho mô hình "đọc" hàng nghìn tỷ đoạn văn bản. Quá trình huấn luyện giống như ép một bộ não khổng lồ phải đi học trong nhiều năm trời gồm các bước đọc sách, làm bài tập, bị chấm điểm, sửa lỗi, rồi lại đọc, lại làm, lại sửa. Sau quá trình đó, Claude không chỉ tiếp thu thông tin mà còn biết cách suy luận, biết khi nào nên dùng cách tiếp cận nào. Toàn bộ tri thức đó được nén vào một mô hình duy nhất.

Và mỗi khi bạn hỏi Claude một câu hỏi, câu trả lời mà Claude đưa ra chính là sản phẩm cuối cùng của toàn bộ quá trình tốn kém đó. Giống như mỗi giọt rượu nguyên chất chứa đựng tinh túy của cả quá trình lên men và chưng cất.

Bây giờ, nếu một công ty khác thu thập đủ nhiều tinh túy đó, có hệ thống, có chiến lược, họ có thể dùng chúng để dạy cho mô hình của mình cách "nghĩ giống Claude" mà không cần lặp lại toàn bộ quá trình tốn kém mà Claude đã làm. Họ không ăn cắp "công thức nấu rượu", họ chỉ nếm đủ nhiều rượu rồi dạy lại cho một người khác cách nấu ra thứ tương tự.

Một mô hình AI lớn khi được huấn luyện sẽ học được cách phân bổ xác suất cho từng token trong câu trả lời. Cái giá trị thực sự không nằm ở câu trả lời cuối cùng, mà nằm ở cách mô hình phân bổ xác suất cho mọi phương án có thể.

Huấn luyện từ đầu giống như học từ toàn bộ sách vở trên thế giới. Mô hình phải tự tìm ra mẫu từ hàng nghìn tỷ token văn bản thô. Quá trình này tốn hàng trăm triệu USD tiền tính toán, và phần lớn năng lượng dùng để loại bỏ nhiễu, phân biệt thông tin tốt với thông tin xấu.

Chưng cất thì khác. Dữ liệu đầu vào đã được "lọc" sẵn qua bộ lọc chất lượng cao nhất có thể. Mỗi câu trả lời của Claude đã là sản phẩm cuối cùng của hàng tỷ USD đầu tư nghiên cứu, huấn luyện, tinh chỉnh. Mô hình đi sau không cần lặp lại toàn bộ hành trình đó, chỉ cần học bắt chước kết quả.

Nói bằng ngôn ngữ hệ thống: Việc chưng cất này bỏ qua toàn bộ quá trình tiến hóa cấu trúc và chỉ sao chép trạng thái cuối cùng. Giống như sao chép DNA của một sinh vật đã thích nghi tốt thay vì lặp lại hàng triệu năm tiến hóa. Đó là chưng cất mô hình. Và đó là lý do nó hiệu quả đến đáng sợ.

2. Họ đã làm như thế nào?

Mỗi công ty có chiến lược riêng, nhắm vào những năng lực khác nhau của Claude.

DeepSeek, với khoảng 150.000 cuộc tương tác, tập trung vào một mục tiêu rất đặc thù. Họ không chỉ muốn học cách Claude suy luận mà còn muốn xem Claude xử lý các chủ đề nhạy cảm chính trị như thế nào. Ở Trung Quốc, các mô hình AI bị buộc phải kiểm duyệt nội dung liên quan đến nhiều chủ đề. DeepSeek muốn tìm cách trả lời những câu hỏi này mà không vi phạm kiểm duyệt, và Claude, một mô hình vận hành trong môi trường tự do ngôn luận, trở thành "giáo viên" lý tưởng cho bài học đó.

Moonshot AI đi xa hơn với 3,4 triệu cuộc tương tác, nhắm vào khả năng Claude sử dụng công cụ bên ngoài gồm viết code, phân tích dữ liệu, và đặc biệt là khả năng "tự hành động", tức là khả năng tự lên kế hoạch và thực hiện nhiều bước liên tiếp mà không cần người dùng cầm tay chỉ việc.

Nhưng MiniMax mới là bên gây ấn tượng nhất về quy mô, với hơn 13 triệu cuộc tương tác, chiếm hơn ¾ tổng số. Anthropic phát hiện chiến dịch của MiniMax khi nó vẫn đang hoạt động, và quan sát được một chi tiết cho thấy mức độ tự động hóa tinh vi đến mức nào: khi Anthropic phát hành mô hình mới, MiniMax chuyển gần một nửa lưu lượng sang mô hình mới đó trong vòng 24 giờ. Nghĩa là hệ thống của họ đủ thông minh để nhận ra có "hàng mới," tự động chuyển hướng, và bắt đầu khai thác ngay lập tức.

Cả ba đều dùng một kiến trúc gọi là "hydra cluster", trong đó một hệ thống trung tâm điều khiển hàng nghìn tài khoản giả cùng lúc, pha trộn lưu lượng khai thác với các yêu cầu sử dụng bình thường để tránh bị phát hiện. Giống như một đội gián điệp trà trộn vào đám đông người mua hàng bình thường trong siêu thị.

II. Anthropic đối phó thế nào?

Anthropic công bố bốn tuyến phòng thủ. Họ xây dựng hệ thống nhận dạng hành vi để phát hiện mẫu bất thường trong lưu lượng truy cập, siết chặt quy trình xác minh tài khoản, chia sẻ thông tin tình báo với các công ty AI khác và nhà cung cấp đám mây, và phát triển các biện pháp ở cấp mô hình nhằm giảm giá trị của câu trả lời khi bị dùng để huấn luyện mà không ảnh hưởng đến người dùng thật.

1. Những gì Anthropic đã triển khai

- Tầng phát hiện (detection): Anthropic đã xây dựng hệ thống phân loại và nhận dạng hành vi để nhận diện các tấn công “chưng cất” trong lưu lượng API, bao gồm phát hiện kỹ thuật khai thác chuỗi suy luận dùng để xây dữ liệu huấn luyện suy luận, cùng công cụ phát hiện hoạt động phối hợp trên số lượng lớn tài khoản.

Nói cách dễ hiểu là khi một người dùng bình thường hỏi Claude, mẫu sử dụng rất đa dạng, thời gian không đều, chủ đề nhảy lung tung. Nhưng khi một hệ thống chưng cất hoạt động, lưu lượng có đặc điểm rõ là khối lượng rất lớn, tập trung hẹp vào năng lực cụ thể, và lặp lại nhiều lần. Hành vi này phù hợp với huấn luyện mô hình chứ không phải tương tác người dùng bình thường.

- Tầng kiểm soát truy cập: Anthropic đã siết chặt xác minh cho tài khoản giáo dục, chương trình nghiên cứu bảo mật, và tổ chức startup, vì đây là những con đường bị khai thác phổ biến nhất để tạo tài khoản giả.

- Tầng chia sẻ tình báo: Anthropic đang chia sẻ các chỉ số kỹ thuật với các lab AI khác, nhà cung cấp đám mây, và cơ quan liên quan để tạo bức tranh toàn diện hơn về bối cảnh.

- Tầng biện pháp đối phó ở cấp mô hình: Anthropic đang phát triển các biện pháp bảo vệ ở cấp sản phẩm, API, và mô hình nhằm giảm tính hữu dụng của đầu ra cho hoạt động chưng cất bất hợp pháp mà không làm giảm trải nghiệm người dùng hợp pháp.

Tuy nhiên các hành động phần lớn là phát hiện và phản ứng, chưa phải phòng ngừa tận gốc. Và chính Anthropic cũng thừa nhận không công ty nào giải quyết được một mình.

Mỗi câu trả lời Claude đưa ra cho bất kỳ ai, dù là người dùng thật hay kẻ khai thác, đều chứa tri thức. Không có cách nào phân biệt hoàn hảo giữa một lập trình viên thật sự đang hỏi câu hỏi khó và một hệ thống chưng cất đang hỏi cùng câu hỏi đó để thu thập dữ liệu. Ranh giới đó mờ về bản chất, không phải mờ vì kỹ thuật chưa đủ tốt.

2. Cáo buộc pháp lý

Từ góc nhìn của Anthropic, công chúng Mỹ và dư luận chung của thế giới theo cách định hướng của Mỹ thì ba công ty Trung Quốc sai rõ ràng, họ vi phạm điều khoản sử dụng, tạo tài khoản giả, vượt qua hạn chế địa lý.

Elon Musk sau khi biết tin này còn gọi đây là một hành động tội lỗi. Dân Mỹ thì rất phẫn nộ với mấy công ty Trung Quốc này và muốn họ phải bị trừng phạt. Nhưng thực ra có muốn trừng phạt cũng không được vì tuy mấy công ty Trung Quốc kia có thể vi phạm luật pháp Mỹ nhưng hiện tại sản phẩm của họ cũng chưa hoạt động gì mấy tại thị trường Mỹ nên cũng chẳng làm gì cụ thể được, luật pháp Mỹ thì lại không thể vươn tới lãnh thổ Trung Quốc được nên cơ bản cũng chỉ là nói mồm.

Và thế là Anthropic bất lực khi:

- Không có đòn bẩy pháp lý trực tiếp, tòa án Mỹ cũng không có thẩm quyền trên lãnh thổ Trung Quốc. Dù Anthropic có kiện thì cũng không có cơ chế nào buộc DeepSeek, Moonshot hay MiniMax ra hầu tòa ở San Francisco. Và tòa án Trung Quốc chắc chắn sẽ không thụ lý vụ kiện theo điều khoản sử dụng của một công ty Mỹ.

- Không có tài sản để đóng băng. Các công ty Mỹ khi kiện nhau còn có thể đóng băng tài sản, yêu cầu lệnh cấm tạm thời, ép hòa giải. Ba công ty Trung Quốc không có tài sản đáng kể ở Mỹ để Anthropic đụng vào. Không có văn phòng, không có tài khoản ngân hàng, không có hoạt động kinh doanh nào trên đất Mỹ mà tòa có thể can thiệp.

Biện pháp kỹ thuật chỉ là phòng thủ, không phải là trừng phạt. Chặn tài khoản giả, siết xác minh, phát hiện mẫu bất thường, tất cả chỉ ngăn chặn hành vi trong tương lai chứ không trừng phạt được hành vi đã xảy ra. 16 triệu cuộc hội thoại đã được thu thập, dữ liệu đã nằm trong tay ba công ty, và không có cách nào "thu hồi" những gì đã cho đi.

Đồng thời, vi phạm điều khoản sử dụng không phải tội hình sự. Terms of Service là hợp đồng dân sự, không phải luật. Vi phạm chúng có thể bị kiện đòi bồi thường thiệt hại, nhưng như đã nói, kiện ai, ở đâu, và ai thi hành phán quyết? Ngay cả ở Mỹ, vi phạm điều khoản sử dụng hiếm khi dẫn đến hậu quả nghiêm trọng. Hàng triệu người vi phạm chúng mỗi ngày mà không ai bị làm sao.

3. Mục đích của cáo buộc

Khi hiểu rằng Anthropic gần như không thể trừng phạt trực tiếp, mục đích thực sự của bài blog cáo buộc trở nên rõ ràng hơn nhiều. Đây không phải hành động pháp lý mà là hành động chính trị.

- Mục tiêu 1: Vận động chính sách xuất khẩu chip. Thời điểm công bố rất đáng chú ý. Chính quyền Trump vừa nới lỏng cho Nvidia xuất khẩu chip H200 sang Trung Quốc. Anthropic cần một câu chuyện cụ thể, có tên tuổi, có số liệu, có chi tiết kỹ thuật, để nói với Washington rằng "nhìn này, nới lỏng chip là sai lầm, họ đang dùng mọi cách để lấy công nghệ của chúng ta." Bài blog không viết cho công chúng, nó viết cho các nghị sĩ và quan chức đang cân nhắc chính sách.

- Mục tiêu 2: Định hình một loạt sự kiện đã diễn ra trước khi đối thủ ra sản phẩm. DeepSeek sắp phát hành V4, được đồn là vượt cả Claude và ChatGPT về coding. Nếu V4 ra mắt và được ca ngợi, câu chuyện được truyền thông đưa tin sẽ là "Trung Quốc đã bắt kịp bằng sáng tạo." Nhưng nếu Anthropic kịp gieo góc nhìn "họ bắt kịp bằng ăn cắp" trước đó, thì dù V4 có giỏi đến đâu, nó sẽ bị phủ bóng bởi nghi ngờ. Đây là chiến thuật kiểm soát kinh điển: ai định khung trước, người đó chiếm lợi thế diễn giải.

- Mục tiêu 3: Tạo áp lực lên các nhà cung cấp proxy trung gian. Ba công ty Trung Quốc truy cập Claude qua các dịch vụ proxy thương mại bán lại quyền truy cập API. Anthropic không thể phạt DeepSeek, nhưng có thể ép các proxy tuân thủ nghiêm ngặt hơn, cắt hợp đồng với proxy vi phạm, và thu hẹp kênh truy cập.

- Mục tiêu 4: Phối hợp ngành. Bài blog kêu gọi các lab AI khác, nhà cung cấp đám mây và cơ quan chính phủ cùng hành động. Khi Anthropic đơn phương chặn thì ba công ty kia chuyển sang chưng cất OpenAI hoặc Google. Chỉ khi cả ngành cùng phòng thủ thì mới tạo được rào cản thực sự. Bài blog là lời kêu gọi liên minh, không phải lời tuyên chiến đơn lẻ.

4. Hệ quả thực tế sẽ ra sao?

Kịch bản khả dĩ nhất: không có trừng phạt nào nhắm trực tiếp vào ba công ty Trung Quốc. Thay vào đó, hệ quả sẽ nằm ở tầng thiết chế, ở những thay đổi làm môi trường hoạt động khó khăn hơn cho mọi bên, không chỉ ba công ty này. Chính sách xuất khẩu chip có thể bị siết lại. Các nhà cung cấp đám mây có thể tăng cường kiểm tra danh tính khách hàng. Quy trình truy cập API có thể phức tạp hơn cho tất cả mọi người, kể cả người dùng hợp pháp. Và ngành AI Mỹ có thể thống nhất về tiêu chuẩn chống chưng cất chung.

III. Câu chuyện đạo đức

Sau những lập luận chỉ ra ở trên thì những sai phạm của mấy công ty Trung Quốc có lẽ được dịch chuyển từ góc nhìn pháp lý sang góc nhìn đạo đức hơn. Kiểu Startup Trung Quốc chơi bẩn, chơi không đẹp, thế nhưng thử nhìn ngược lại xem các công ty Mỹ có chơi đẹp hay không?

Chính Anthropic cũng vừa phải trả 1,5 tỷ đô la Mỹ để dàn xếp vụ kiện bản quyền lớn nhất lịch sử. Chuyện là thế này: để huấn luyện Claude, Anthropic đã "đọc" hàng triệu cuốn sách có bản quyền mà không xin phép tác giả. Một tòa án Mỹ phán quyết rằng việc đó vi phạm bản quyền. Anthropic trả tiền dàn xếp mà không thừa nhận sai.

Có phải điểm này Anthropic đâu đó cũng giống với các "tội phạm" đến từ Trung Quốc mà họ đang cáo buộc không?

Anthropic lấy tri thức từ hàng triệu tác giả mà không xin phép để xây dựng Claude, rồi cáo buộc ba công ty Trung Quốc lấy tri thức từ Claude không xin phép để xây dựng mô hình của họ. Về mặt cấu trúc, hai hành động này là cùng một hình mẫu: dùng sản phẩm trí tuệ của người khác làm nguyên liệu cho sản phẩm của mình. Chỉ khác ở chỗ ai đang ở vị thế mạnh hơn trong từng mối quan hệ.

Khi Anthropic đối diện với các tác giả sách, Anthropic là bên mạnh, có tiền, có đội ngũ pháp lý hùng hậu, có khả năng dàn xếp bằng tiền rồi tiếp tục kinh doanh. Khi Anthropic đối diện với ba công ty Trung Quốc, Anthropic là bên mạnh ở một nghĩa khác: họ có sân nhà ở Mỹ, có khả năng vận động chính phủ, có thể biến vấn đề kinh doanh thành vấn đề an ninh quốc gia.

Luật pháp vốn không phải là công lý phổ quát. Luật pháp là hệ thống quy tắc được thiết kế bởi những người có quyền lực, phục vụ trước hết cho trật tự mà họ hưởng lợi. Khi Anthropic nói "vi phạm điều khoản sử dụng," họ không ám chỉ đó lời phán xét đạo đức. Đó là lời nhắc nhở rằng bạn đang chơi trong sân của tôi, theo luật của tôi, và bạn đã phạm luật của tôi. Còn việc luật đó có công bằng hay không lại là câu chuyện hoàn toàn khác, quan trọng ai có đủ sức mạnh để tạo ra luật và áp đặt nó cho người khác thực thi.

1. Lịch sử có dạy ta điều gì không?

Đây không phải lần đầu tiên thế giới chứng kiến hình mẫu này. Thập niên 1950 và 1960, Nhật Bản bị phương Tây cáo buộc sao chép công nghệ ô tô, điện tử, thép. Thập niên 1970 và 1980, Hàn Quốc bị cáo buộc tương tự. Cả hai đều trải qua giai đoạn sao chép, rồi dần tự chủ, rồi cuối cùng dẫn đầu trong nhiều lĩnh vực. Sony, Toyota, Samsung, Hyundai bắt đầu bằng sao chép và kết thúc bằng sáng tạo đột phá.

Liệu DeepSeek, Moonshot, MiniMax có đi theo con đường tương tự? Không ai biết chắc. Nhưng lịch sử gợi ý rằng áp lực bị cắt nguồn không chỉ gây đau, mà còn ép ra thích nghi. Khi không còn đường tắt, đôi khi con đường dài lại dẫn đến nơi xa hơn.

Vụ DeepSeek R1 năm ngoái là minh chứng sống: bị hạn chế chip AI cao cấp, DeepSeek vẫn tạo ra mô hình suy luận cạnh tranh ngang ngửa với các lab Mỹ bằng cách tối ưu kiến trúc để cần ít tài nguyên hơn nhiều lần. Đôi khi, chính sự thiếu thốn lại là người thầy giỏi nhất.

2. Một trật tự mới đang hình thành

Thế giới AI đang ở trong giai đoạn mà các nhà vật lý gọi là "rìa hỗn loạn". Đó là vùng ranh giới giữa trật tự và hỗn loạn, nơi phức tạp nhất, năng động nhất, và cũng bất ổn nhất. Trật tự cũ gồm luật bản quyền, sở hữu trí tuệ truyền thống, biên giới quốc gia trong thương mại công nghệ được xây dựng cho một thế giới mà tri thức nằm trong sách, trong bằng sáng chế, trong trí tuệ từng người. Bây giờ tri thức nằm trong hàng tỷ tham số của một mô hình toán học, có thể sao chép bằng cách đơn giản là hỏi nó đủ nhiều câu hỏi đúng. Luật chơi cũ không còn khớp với thực tế mới.

Và trong khoảng trống giữa trật tự cũ đang sụp đổ và trật tự mới chưa hình thành, các bên đang tranh giành quyền định hình luật chơi mới. Anthropic và OpenAI muốn luật chơi bảo vệ mô hình đóng, vì đó là nền tảng mô hình kinh doanh của họ. Các công ty Trung Quốc muốn tiếp cận tự do, vì họ đang ở thế đuổi theo. Cộng đồng mã nguồn mở muốn tri thức AI là tài sản chung, vì họ tin rằng sự phát triển nhanh nhất đến từ chia sẻ. Chính phủ Mỹ muốn duy trì ưu thế công nghệ, vì đó là lợi ích chiến lược.

Mỗi bên đang cố gắng viết luật chơi có lợi nhất cho mình, và gọi luật chơi đó bằng những cái tên đẹp đẽ: "bảo vệ sở hữu trí tuệ," "an ninh quốc gia," "tự do tri thức," "dân chủ hóa AI."

IV. Xung đột của các startup hay là cuộc chiến giữa 2 siêu cường

Nếu chỉ nhìn vào vụ chưng cất này như một vụ "ăn cắp công nghệ," chúng ta sẽ bỏ lỡ bức tranh lớn hơn nhiều. Thực ra thì việc các công ty startup Mỹ vả mặt các công ty startup Trung Quốc chỉ là sân khấu trên bề nổi còn cuộc cạnh tranh địa chính trị giữa 2 siêu cường Mỹ Trung mới thực sự là hậu trường thực sự phía sau, đây là một cuộc chiến thực sự và mỗi bên có những lợi thế riêng. Phân tích theo cấu trúc lực thực tế ta sẽ thấy

Lợi thế cấu trúc của phía Mỹ gồm Anthropic, OpenAI, Google: Hệ sinh thái nghiên cứu mạnh, nguồn vốn dồi dào, kiểm soát chuỗi cung ứng chip qua Nvidia và TSMC, và khả năng vận động chính sách trong chính phủ Mỹ. Đây là lợi thế ở tầng thiết chế, rất khó sao chép.

Lợi thế cấu trúc của phía Trung Quốc: Lượng kỹ sư AI khổng lồ, thị trường nội địa 1,4 tỷ người để triển khai và thu thập dữ liệu, sự hậu thuẫn của nhà nước không bị ràng buộc bởi chu kỳ bầu cử hay áp lực cổ đông, và quan trọng nhất là áp lực sinh tồn. Khi bị cắt chip, bị cắt truy cập API, bị cắt mọi con đường dễ, áp lực đó buộc phải sáng tạo.

Yếu tố không bên nào kiểm soát: Mô hình mã nguồn mở đang phát triển cực nhanh. Meta phát hành Llama, nhiều lab khác cũng mở mã nguồn. Mỗi mô hình mở là một nguồn chưng cất mà không ai chặn được. Xu hướng này làm giảm giá trị của mô hình đóng theo thời gian. Nếu open source đủ mạnh, toàn bộ cuộc chiến chưng cất trở nên vô nghĩa vì ai cũng có quyền truy cập miễn phí.

Và từ đây chúng ta lại thấy là bên cạnh cuộc chiến này có một cuộc chiến khác là cuộc chiến giữa 2 mô hình mã nguồn mở và mô hình đóng. Phía Mỹ đương nhiên sẽ ưa thích một mô hình đóng còn phía Trung Quốc dường như mã nguồn mở chính là lựa chọn thích hợp nhất, khả dĩ nhất để họ có thể cạnh tranh lại với Mỹ trong vị thế của kẻ yếu hơn.

Phía Mỹ, với Anthropic và OpenAI dẫn đầu, đi theo mô hình đóng. Họ chi hàng tỷ đô la huấn luyện mô hình, rồi bán quyền truy cập qua API hoặc gói thuê bao hàng tháng. Logic kinh doanh rất rõ ràng: đầu tư lớn, thu hồi qua bán sản phẩm, dùng lợi nhuận để đầu tư tiếp. Nhưng logic kinh doanh đó chỉ hoạt động nếu sản phẩm của bạn vượt trội đủ xa so với phương án miễn phí. Khoảng cách chất lượng giữa mô hình đóng và mô hình mở chính là thứ bảo vệ giá trị, và toàn bộ giá trị của Anthropic định giá 380 tỷ đô la được xây trên giả định rằng khoảng cách chất lượng này lớn.

Phía Trung Quốc lại chọn con đường khác. DeepSeek mở R1, Alibaba mở Qwen và nhiều lab khác cũng theo xu hướng tương tự. Thoạt nhìn, điều này vô lý là tại sao lại cho không thứ mà mình đã tốn rất nhiều tiền để xây dựng?

Nhưng nếu lùi lại và nhìn từ vị thế cấu trúc mà các công ty Trung Quốc đang đứng, open source không phải hành động hào phóng. Đó là nước cờ chiến lược sắc bén nhất có thể.

Khi tất cả mô hình đều đóng, cuộc chơi biến thành "ai huấn luyện giỏi nhất thắng". Mỹ thắng cuộc chơi đó vì có chip mạnh nhất, có vốn nhiều nhất, có nhân tài hội tụ. Trung Quốc bị chặn ở cả ba nguồn lực đó: chip bị cấm xuất khẩu, vốn khó huy động ở quy mô tương đương, nhân tài bị hút sang Mỹ. Chơi theo luật này, Trung Quốc thua là tất yếu.

Nhưng khi mô hình mở đủ tốt, cuộc chơi thay đổi hoàn toàn. Câu hỏi không còn là "ai có mô hình mạnh nhất" mà là "ai triển khai ứng dụng tốt nhất." Và trên sân chơi ứng dụng, lợi thế cấu trúc nghiêng hẳn về phía Trung Quốc. Thị trường 1,4 tỷ người, hạ tầng thanh toán di động phổ biến nhất thế giới, kinh nghiệm triển khai nhanh ở quy mô khổng lồ. Họ là một nền văn hóa kinh doanh cực kỳ nhanh nhạy trong việc biến công nghệ mới thành sản phẩm tiêu dùng. Nếu mô hình nền tảng trở thành hàng hóa phổ thông giống như điện hay internet, thì người thắng không phải nhà máy điện mà là người xây được nhiều thiết bị dùng điện nhất.

Mở mã nguồn là cách biến mô hình nền tảng thành hàng hóa phổ thông.

Và đây mới là điều tinh vi nhất, chi phí tấn công thấp hơn rất nhiều so với chi phí phòng thủ. DeepSeek mở R1 gần như không tốn thêm gì, vì mô hình đã huấn luyện xong rồi, mở ra chỉ là quyết định phân phối. Nhưng Anthropic để phản ứng thì phải chọn giữa toàn lựa chọn tồi: giảm giá thì mất doanh thu, chứng minh vượt trội thì tốn thêm hàng tỷ R&D, lobby chặn mô hình mở thì mất thiện cảm cộng đồng công nghệ. Mỗi phương án đều đau hơn hành động mở mã nguồn ban đầu.

Nhưng sẽ sai nếu nói đây thuần túy là tính toán chiến lược, các công ty Mỹ và Trung Quốc có thể có chiến lược nhưng bản thân chiến lược ấy cũng được biến đổi rất nhanh theo môi trường công nghệ - thứ vốn là một hệ thống phức hợp khổng lồ.

Cũng giống như vụ chưng cất, có nhiều dòng lực chảy đồng thời và mã nguồn mở là giao điểm nơi chúng hội tụ.

Chính phủ Trung Quốc hưởng lợi vì mô hình mở lan tỏa ảnh hưởng công nghệ toàn cầu. Cộng đồng lập trình viên hưởng lợi vì có công cụ miễn phí. Hàng triệu doanh nghiệp nhỏ hưởng lợi vì tiếp cận được AI mà không cần trả phí cho Anthropic hay OpenAI. Và chính các lab Trung Quốc cũng hưởng lợi ngược lại, vì khi hàng triệu người dùng mô hình mở, họ tạo ra dữ liệu phản hồi, phát hiện lỗi, xây ứng dụng mới, tất cả đều quay về giúp cải thiện mô hình thế hệ tiếp theo. Vòng tăng cường đó không cần chip Nvidia mới nhất để vận hành, nó chạy bằng số lượng người tham gia.

V. Còn chúng ta thì sao?

Chúng ta ở đây là nhân dân Việt Nam vốn dĩ ở vị thế của kẻ thấp, chỉ là khán giả đứng xem người ta choảng nhau. Chắc sẽ có người cổ vũ cho Mỹ và cũng không ít người cổ vũ cho Trung Quốc, có người thích 2 ông choảng nhau còn anh em ta làm ngư ông đắc lợi. Có vẻ cái nhóm thứ 3 sẽ đông nhất.

Nếu nhìn từ góc độ kỹ thuật của một người trong ngành, mình ủng hộ Mỹ vì họ là những doanh nghiệp dẫn đầu thị trường. Là người tiên phong trong đổi mới sáng tạo mình ủng hộ các doanh nghiệp Mỹ. Bây giờ, mình vẫn đang trả tiền cho Anthropic mỗi tháng và cũng rất hâm mộ Dario Amodei - CEO của công ty. Mình cũng thích triết lý phát triển sản phẩm của Anthropic đề cao sự an toàn và mục đích vì nhân loại hơn là chạy theo các mục tiêu thương mại như các công ty khác.

Nhưng nhìn từ khía cạnh chính trị, xã hội mình cũng có khá thông cảm với các startup của Trung Quốc vì chính mình đang ở cái vị thế thân phận nhược tiểu của các nước đi sau mút mùa như Việt Nam, có tâm nhưng không có lực để theo đuổi những khát vọng mà ai ai cũng muốn làm. Đôi khi cũng mong những đội có vị thế chiếu dưới như Trung Quốc có thể chiến thắng.

Còn từ góc nhìn kinh tế thì rõ ràng là sự vươn lên của Trung Quốc và cuộc chiến AI này tạo ra cơ hội cho việc phổ biến mã nguồn mở. Đây là cửa sổ hẹp để toàn thể giới có thể tiếp cận với nguồn sức mạnh vô tiền khoáng hậu trong lịch sử với giá rẻ. Thôi cứ xem hai đồng chí Mỹ - Trung kia va chạm, ta làm ngư ông đắc lợi. Nghe thực dụng thô thiển nhưng là lựa chọn tối ưu cho anh em vô sản toàn thế giới các bạn ạ.

Quay trở lại nói chuyện nghiêm túc một chút. Mình nghĩ sự kiện vừa rồi kia nghe có vẻ xa xôi nhưng thực ra nó có ảnh hưởng trực tiếp đến mỗi người theo ít nhất hai cách.

Thứ nhất, nếu chưng cất quy mô lớn tiếp tục và các mô hình bị sao chép mất đi rào chắn an toàn, thì thế giới sẽ ngập tràn các AI mạnh mẽ nhưng thiếu kiểm soát. Đây không phải viễn tưởng. Khi bạn chưng cất Claude, bạn chỉ lấy được "cách trả lời" mà không lấy được "cách từ chối." Bởi vì trong 16 triệu câu hỏi mà ba công ty Trung Quốc gửi đi, tất cả đều là những câu Claude đồng ý trả lời. Những câu Claude từ chối thì không tạo ra dữ liệu. Kết quả là mô hình chưng cất biết rất nhiều nhưng không biết nói "không," giống một bác sĩ giỏi chẩn đoán nhưng không biết khi nào nên chuyển bệnh nhân đi nơi khác.

Thứ hai, cuộc chiến này sẽ định hình ai kiểm soát AI trong thập kỷ tới. Nếu AI bị tập trung trong tay một vài công ty ở một vài quốc gia, đó là một loại quyền lực chưa từng có trong lịch sử. Nếu AI được phân tán rộng rãi qua mã nguồn mở, đó lại là một thế giới hoàn toàn khác. Hướng đi nào thắng phụ thuộc vào chính cuộc tranh giành đang diễn ra lúc này.

Câu chuyện Anthropic và ba công ty Trung Quốc là câu chuyện về một thế giới đang chuyển mình, nơi luật chơi cũ đã rạn nứt mà luật chơi mới chưa thành hình, nơi mỗi bên đều vừa là kẻ khai thác vừa là người bị khai thác, tùy vào ranh giới nào đang được vẽ và ai đang cầm bút.

Trong cơn hỗn mang đó, có lẽ điều quan trọng nhất không phải là chọn phe, mà là hiểu rõ cuộc chơi. Bởi vì khi bạn không hiểu trò chơi đang diễn ra, bạn không phải người chơi. Bạn là quân cờ.

Còn bài viết này cũng là một dạng chưng cất ra những bài học từ sự kiện kia. Mình cũng mong là những ai hiểu được bài viết này cũng sẽ chưng cất được điều gì đó có giá trị cho bản thân mình.

Quan điểm - Tranh luận

/quan-diem-tranh-luan

Bài viết nổi bật khác

- Hot nhất

- Mới nhất